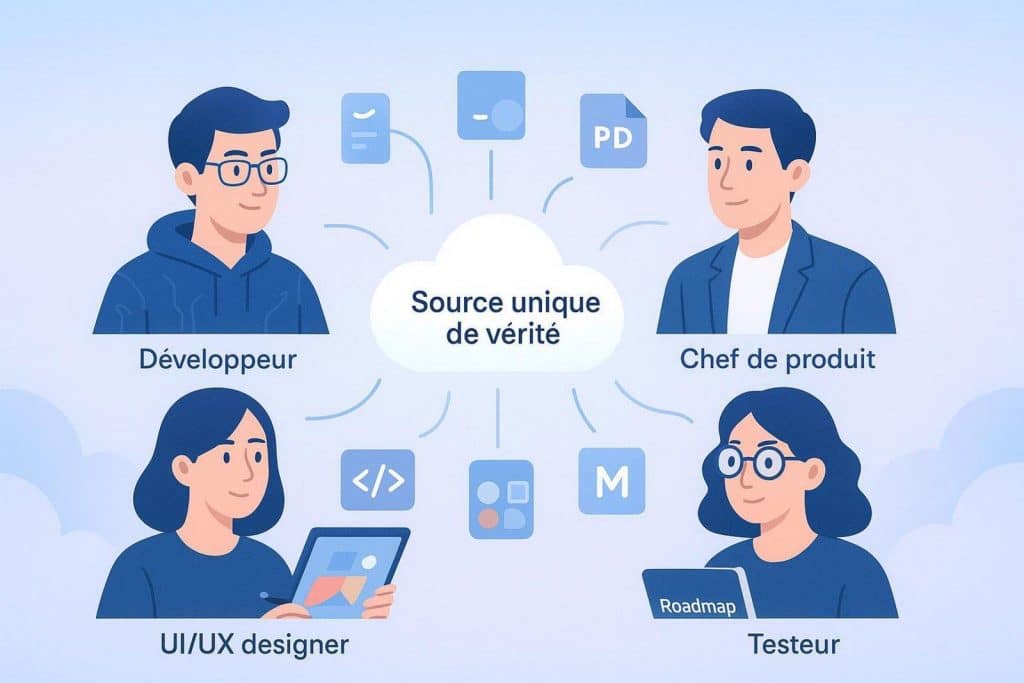

Le contrôle de version dans le cloud est devenu un élément central des organisations modernes, car il fournit une « source unique de vérité » indispensable à la cohésion des équipes produit pluridisciplinaires. En permettant aux développeurs, designers, chefs de produit et testeurs de travailler simultanément sur un même projet sans se marcher dessus, il protège l’intégrité des données, rend les changements parfaitement traçables et accélère les cycles d’innovation. Sans cette infrastructure en ligne, la collaboration asynchrone et la gestion de la complexité logicielle actuelle tourneraient rapidement au chaos, avec à la clé des pertes de fichiers et des malentendus coûteux.

Dans un monde où la numérisation a bouleversé les méthodes de travail traditionnelles, l’adoption d’un stockage cloud performant n’est plus un luxe technologique mais un choix stratégique de base. La collaboration dans le cloud est devenue incontournable pour les entreprises en constante recherche d’efficacité. Elle permet d’accéder aux ressources en temps réel, supprimant les retards liés aux échanges manuels de fichiers. Cette fluidité rend les équipes distribuées plus réactives, et chaque membre, quel que soit son fuseau horaire, peut contribuer en étant sûr de travailler sur la version la plus récente et validée.

L’évolution des systèmes de contrôle de version (VCS) suit celle des besoins métier. D’abord pensés pour des développeurs isolés, ils incluent aujourd’hui des fonctions de sécurité, de conformité et d’automatisation qui couvrent l’ensemble du cycle de vie d’un produit numérique. Les entreprises les utilisent pour simplifier leurs processus, limiter les erreurs humaines et déployer leurs innovations plus rapidement, dans un marché où le « time-to-market » est une question de survie.

Qu’est-ce que le contrôle de version dans le cloud ?

Définition et principes du contrôle de version

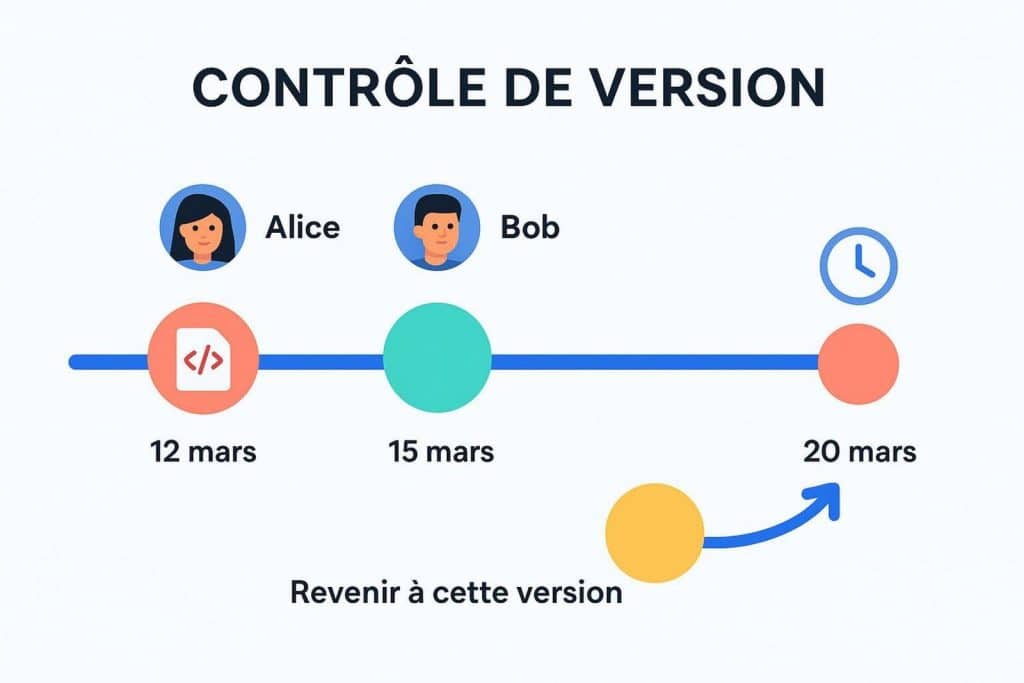

Le contrôle de version, aussi appelé « gestion de source » ou « versionnage », est une pratique clé du développement logiciel qui consiste à suivre et gérer tous les changements apportés au code et aux fichiers associés au fil du temps. Concrètement, un système de contrôle de version (VCS) fonctionne comme une base de données qui enregistre chaque modification. Il conserve un historique complet et permet de suivre la progression d’un projet depuis sa première ligne de code jusqu’à son état actuel.

Le principe repose sur la création de « captures instantanées » (snapshots) du projet. À chaque fois qu’un contributeur valide une modification (un « commit »), le système enregistre l’auteur, la date, l’heure et un commentaire expliquant le changement. Cette traçabilité est clé : elle permet de revenir en arrière en cas d’erreur, de comparer différentes versions pour identifier l’origine d’un bug, et de protéger le code source – souvent le principal actif logiciel de l’entreprise – contre les accidents ou les erreurs humaines.

Un bon logiciel de contrôle de version ne se limite pas au stockage de fichiers ; il permet un flux continu de changements sans imposer une méthode trop rigide. Il aide à organiser l’arborescence des fichiers de manière logique et donne aux équipes la liberté d’expérimenter sur des branches parallèles sans compromettre la stabilité du produit principal. Cette souplesse fait du VCS bien plus qu’un simple outil d’archivage : c’est un véritable moteur de collaboration agile.

Différence entre contrôle de version sur site et dans le cloud

La différence entre une installation sur site (on-premise) et une solution cloud tient surtout à l’infrastructure et à l’accessibilité. Un système sur site requiert d’importants investissements en matériel, des compétences techniques pour l’entretien des serveurs et une gestion rigoureuse de la sécurité physique et du réseau. Pour les organisations sans infrastructure informatique solide, cela peut devenir un lourd fardeau opérationnel qui limite leur souplesse.

À l’opposé, le contrôle de version basé sur le cloud, proposé en mode SaaS (Software as a Service) comme GitHub ou GitLab, déplace la complexité sur le fournisseur. Ces solutions montent facilement en charge : le système suit la croissance de l’équipe et du code sans perte de performance. Les mises à jour de sécurité et les sauvegardes sont automatiques, ce qui maintient l’entreprise protégée contre les nouvelles menaces sans intervention manuelle continue.

Le plus grand avantage du cloud reste l’accès de partout. Un système sur site peut être difficile d’accès pour des collègues à distance ou des partenaires externes (avec souvent des VPN compliqués), alors que le cloud permet une collaboration en temps réel depuis n’importe où. Cette approche réduit les coûts de gestion et laisse les équipes se concentrer sur leur activité principale : créer de la valeur, plutôt que de gérer des serveurs.

Pourquoi les équipes produit pluridisciplinaires ont-elles besoin du contrôle de version dans le cloud ?

Multiplicité des profils : développeurs, designers, chefs de produit, QA

Une équipe de production moderne ne se compose plus seulement de développeurs. On y trouve aussi des designers UI/UX qui créent des éléments graphiques, des chefs de produit qui écrivent des spécifications et des ingénieurs QA (Quality Assurance) qui produisent des scripts de test. Chacun génère des fichiers importants qui doivent rester alignés. Le contrôle de version dans le cloud, sur des plateformes, regroupe ces éléments au même endroit, ce qui permet, par exemple, à un designer de savoir exactement quelle version de ses icônes est utilisée dans le code.

Pour les chefs de produit, ces systèmes offrent une visibilité très fine sur l’avancement réel des tâches. Ils peuvent suivre les changements sans demander de rapports manuels, car le code et la documentation avancent en parallèle. Cette transparence renforce la responsabilité de chacun, puisque chaque contribution est signée et datée. Les flux de travail rendent les rôles et responsabilités clairement visibles.

Les équipes QA disposent, elles, d’un environnement stable pour tester les nouvelles fonctionnalités. Elles peuvent isoler une version précise du produit pour faire des tests de régression, tout en sachant que le reste de l’équipe continue à développer sur d’autres branches. Cette cohabitation harmonieuse de profils variés est rendue possible par la capacité du cloud à gérer des volumes de données divers et des droits d’accès variés selon les métiers.

Complexité des workflows et besoins de synchronisation

Le développement d’un produit complexe implique souvent la modification simultanée de centaines de fichiers. Sans un système solide de synchronisation, le risque de conflits — quand deux personnes changent la même ligne de code ou le même fichier de configuration — est presque garanti. Le contrôle de version règle ce problème en suivant chaque changement et en fournissant des outils pour fusionner (merge) les contributions. Cela évite le verrouillage frustrant des fichiers, où une personne pourrait bloquer l’avancement des autres.

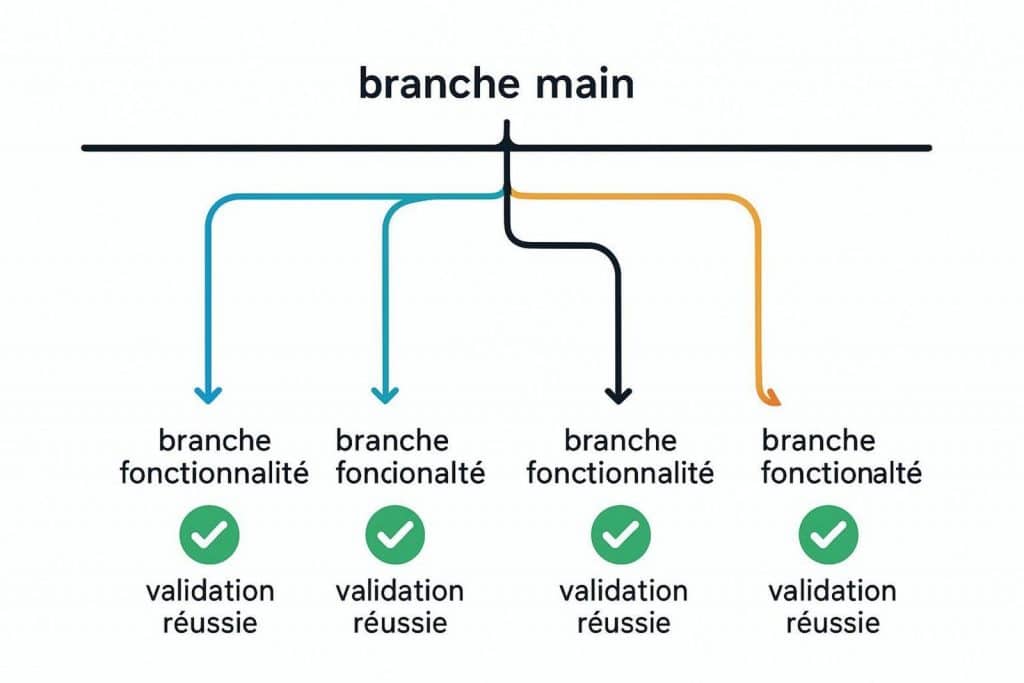

Les workflows modernes, comme le feature branching, permettent de développer une nouvelle fonctionnalité dans un espace isolé. Une fois le travail terminé et testé, il rejoint la branche principale. Cette méthode maintient la version « stable » du produit à l’abri du code en cours de développement. Dans le cloud, ces processus sont facilités par des interfaces visuelles qui permettent de visualiser les différences entre versions avant toute fusion, ce qui réduit fortement le risque d’introduire des bugs.

La synchronisation ne concerne pas seulement le code, mais aussi l’infrastructure. Avec l’approche « tout en tant que code » (infrastructure, sécurité, réseau), le VCS devient le centre de pilotage de l’ensemble du système informatique. La synchronisation automatique entre le dépôt cloud et les environnements de production fait en sorte que ce qui a été validé en équipe soit exactement ce qui est déployé aux utilisateurs, ce qui maintient le produit cohérent de bout en bout.

Besoin de collaboration rapide, transparente et asynchrone

Avec le travail hybride et les équipes réparties sur plusieurs fuseaux horaires, la collaboration asynchrone est devenue incontournable. Le contrôle de version dans le cloud permet à un développeur en Asie d’envoyer ses changements le soir, pour qu’un collègue en Europe les relise le lendemain matin. Tout le contexte des décisions se trouve dans les messages de validation et les discussions associées, ce qui évite de longues réunions de mise au point.

La vitesse d’exécution augmente également fortement. Au lieu d’attendre des mises à jour par email ou de fouiller dans des dossiers partagés mal rangés, les membres de l’équipe voient les modifications en direct. Cette réactivité permet de repérer et de corriger les erreurs potentielles presque immédiatement. La collaboration en temps réel soutient une culture d’ouverture, avec un retour rapide et constructif, ce qui rend le développement plus fluide et moins figé.

Cette transparence facilite également l’intégration des nouveaux arrivants. Un nouveau membre peut consulter l’historique du projet, lire les notes de version et comprendre pourquoi certains choix techniques ont été faits il y a plusieurs années. Le système de contrôle de version devient la mémoire de l’équipe, un capital de connaissances précieux qui protège l’entreprise contre la perte de savoir lorsqu’enclaves clés quittent l’entreprise.

Quels sont les avantages spécifiques du contrôle de version dans le cloud pour la collaboration ?

Visibilité des contributions en temps réel et historique partagé

Un des bénéfices les plus concrets est la visibilité complète offerte à chacun. Chaque modification, même minime, est enregistrée avec son contexte. Cette vue centralisée de l’évolution du projet facilite la planification et le suivi. On ne se demande plus « qui a fait quoi », car l’historique annoté y répond immédiatement. Un développeur peut comprendre l’intention d’un bloc de code complexe simplement en lisant le message de commit associé.

L’historique partagé joue aussi un rôle de filet de sécurité psychologique. Le fait de pouvoir revenir rapidement à une version antérieure encourage l’expérimentation. Les équipes peuvent essayer des idées ambitieuses sans craindre de casser définitivement la base de code principale. En cas d’échec, le retour en arrière est simple, rapide et documenté, avec un impact minimal sur le reste du groupe.

Cette visibilité est aussi utile pour les audits et la conformité. Dans des secteurs très réglementés comme la finance ou la santé, prouver qui a validé un changement donné à une date précise est une obligation légale. Le contrôle de version dans le cloud génère ces traces automatiquement, ce qui rend les audits moins stressants et plus transparents pour les autorités.

Réduction des conflits et gestion des modifications simultanées

Les conflits de fichiers sont un véritable problème dans une collaboration non structurée. Les systèmes de contrôle de version cloud utilisent des algorithmes avancés pour détecter les changements incompatibles avant leur intégration. Si deux développeurs modifient la même fonction, le système signale un conflit de fusion et propose des outils pour le résoudre correctement. On remplace ainsi le désordre des fichiers intitulés « finalv2modifiéparJean.doc » par un processus encadré.

La gestion des modifications simultanées repose sur le principe de fusion. Le système peut combiner automatiquement les modifications apportées à différentes parties d’un même fichier. Plusieurs personnes peuvent donc travailler sur le même composant sans se bloquer mutuellement. Cette fluidité est importante pour maintenir le rythme du projet, surtout pendant les sprints intenses où chaque jour compte.

Le verrouillage de fichiers, même s’il existe dans certains systèmes centralisés plus anciens comme SVN pour des types de fichiers particuliers, est en général évité dans les systèmes modernes comme Git. On préfère une approche dite « optimiste » où chacun travaille dans son espace, et où la mise en commun se fait au moment de l’intégration. Cette façon de faire limite les goulots d’étranglement et permet à l’équipe d’avancer rapidement sans attendre qu’un fichier soit « libéré ».

Accès universel et gestion des droits pour équipes distribuées

Le cloud efface les barrières géographiques. Une équipe produit peut réunir des freelances aux États-Unis, une agence de design en France et des développeurs internes en Inde. Tous travaillent sur le même dépôt avec un niveau de performance similaire. Cet accès global est complété par une gestion fine des droits. On peut accorder un accès en lecture seule à des partenaires externes, tout en réservant le droit de fusion (merge) à des responsables techniques confirmés.

Les plateformes cloud telles que Bitbucket ou GitLab s’intègrent souvent aux annuaires d’entreprise (LDAP, SSO), ce qui simplifie la gestion des identités. Lorsqu’un employé quitte l’entreprise, ses accès sont coupés d’un seul coup sur l’ensemble des projets, ce qui protège les actifs numériques. À l’inverse, un nouveau collaborateur peut être ajouté en quelques secondes, avec tous les droits nécessaires pour qu’il soit opérationnel très vite.

La gestion des rôles permet également de limiter la surcharge d’informations. Un rédacteur technique peut se concentrer sur les dossiers de documentation, tandis qu’un ingénieur DevOps s’occupe des scripts de déploiement, tout cela dans un projet structuré de manière cohérente, mais segmenté selon les besoins en matière de sécurité et de lisibilité.

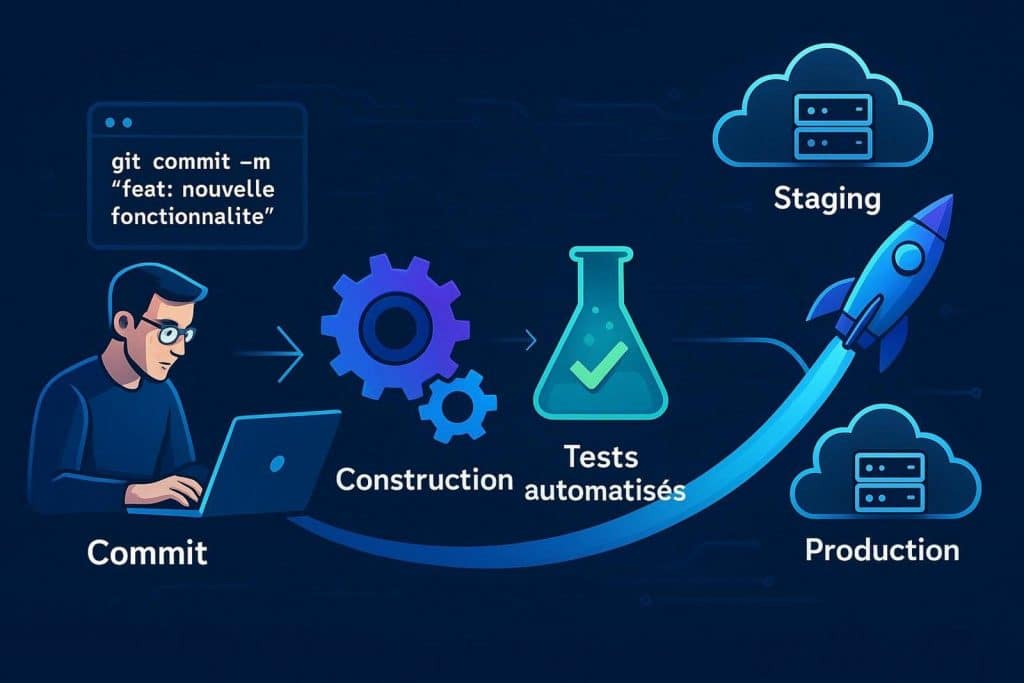

Automatisation des tests et des déploiements via l’intégration continue

Le contrôle de version dans le cloud constitue le point de départ naturel des chaînes d’intégration continue et de déploiement continu (CI/CD). À chaque nouvelle version enregistrée, des scripts automatiques peuvent lancer des séries de tests pour vérifier que les changements n’ont pas cassé des fonctions existantes. Cette automatisation fournit des résultats réguliers et fait gagner beaucoup de temps aux développeurs, qui n’ont plus à refaire ces contrôles manuellement.

En lien direct avec les outils de déploiement, le code validé peut être automatiquement déployé vers des environnements de test ou de production. Le délai entre le développement d’une fonctionnalité et sa mise à disposition des utilisateurs est réduit. Les cycles de livraison deviennent plus courts, plus fréquents et plus fiables, car le risque d’erreur humaine lors du déploiement est presque supprimé.

L’IA s’inscrit aussi dans ces processus. Des assistants comme GitHub Copilot utilisent les données des dépôts pour suggérer des améliorations de code ou générer des messages de validation automatiques. Ces nouveautés, combinées à l’automatisation classique, permettent aux équipes de se concentrer sur des tâches complexes à forte valeur ajoutée, tout en laissant les tâches répétitives aux machines.

Sécurité, sauvegarde automatique et conformité des données

La sécurité est une priorité pour les fournisseurs de VCS cloud. Ils mettent en place des protocoles de chiffrement avancés, des systèmes d’authentification multi-facteurs et des mécanismes de détection d’intrusion que peu d’entreprises pourraient déployer seules. Les données sont recopiées vers plusieurs centres de données, ce qui garantit une disponibilité élevée même en cas de panne majeure sur un site.

Les sauvegardes automatiques suppriment le risque de perte de données en cas de crash du disque dur ou de mauvaise manipulation locale. Dans les systèmes distribués comme Git, chaque développeur garde souvent une copie locale complète de l’historique, ce qui renforce encore la résilience. Si le serveur central tombe, le projet peut être restauré depuis n’importe quel poste de l’équipe.

Pour les entreprises européennes, le choix de solutions souveraines ou conformes au RGPD est un enjeu majeur. Des acteurs comme NetExplorer ou d’autres solutions cloud certifiées garantissent que les données personnelles et le code source sont stockés conformément aux lois en vigueur. Cette conformité constitue un atout lors des audits de sécurité et un argument fort pour rassurer les clients quant à la protection de leur propriété intellectuelle.

Quels défis et risques y a-t-il en l’absence de contrôle de version cloud au sein d’équipes pluridisciplinaires ?

Perte ou duplication de données

Sans contrôle de version centralisé, les équipes retombent vite dans le piège des copies locales multiples. Il devient très facile de modifier ou de supprimer un fichier dans la mauvaise copie, ce qui entraîne une perte de travail irréversible. La duplication des efforts est également fréquente : deux personnes peuvent corriger le même problème chacune de leur côté, sans le savoir, ce qui gaspille du temps et des ressources.

Le désordre des noms de fichiers est un autre signe classique d’absence de VCS. Les serveurs se remplissent de versions « finales », « finalesV2″, « dernièreversion_corrigée », ce qui crée une confusion totale quant à la version réellement en production. Ce désordre empêche d’avoir une vue claire de l’état du projet et accroît le risque de déployer une version obsolète ou instable, au détriment de l’image de l’entreprise.

La perte de données peut également être matérielle. Un ordinateur volé ou un disque dur en panne, contenant la seule version à jour d’un module critique, peut bloquer un projet pendant des semaines. Le cloud joue ici un rôle d’assurance, en gardant le travail de l’équipe à l’abri, quel que soit l’état du matériel de chacun.

Mauvaise traçabilité et audits impossibles

Sans un système structuré, retrouver l’origine d’un problème devient une enquête compliquée. On perd du temps à recouper des modifications floues et à chercher qui a changé quoi. Cette opacité est particulièrement risquée dans les secteurs réglementés, où l’incapacité à fournir un historique de changements peut mener à de fortes amendes ou à l’échec d’une certification.

L’absence de traçabilité freine également l’apprentissage collectif. On ne peut pas analyser les erreurs ni éviter qu’elles se reproduisent si l’on ne connaît pas le contexte des changements. Le contrôle de version apporte ce contexte et permet de transformer chaque bug en une occasion d’amélioration continue grâce à l’analyse des causes à partir d’un historique complet.

Sans messages de validation clairs et intégrés aux outils de gestion de projet (comme Jira), le lien entre le « pourquoi » (le besoin métier) et le « comment » (le code livré) disparaît. Cela crée des zones d’ombre en matière de conformité et rend la maintenance à long terme très difficile, voire impossible, une fois que les développeurs d’origine ont quitté le projet.

Frein à l’innovation et baisse de productivité

La peur de « casser » le système est l’un des plus grands freins à l’innovation. Sans moyen simple de revenir en arrière, les membres de l’équipe deviennent trop prudents et hésitent à tester de nouvelles idées. Cette inertie technique se traduit par un produit qui vieillit mal et perd du terrain face à ses concurrents. Le VCS cloud, en offrant un cadre sûr pour expérimenter, libère cette créativité.

La baisse de productivité est également liée à l’organisation. Les synchronisations manuelles, les réunions de coordination inutiles et le temps passé à résoudre des conflits évitables prennent une part importante des journées de travail. Une collaboration non structurée peut allonger les délais des projets de près de la moitié. C’est un coût caché, mais lourd, pour l’entreprise.

Le manque de visibilité sur l’avancement démotive également les équipes. Avoir l’impression de travailler sans savoir si son travail s’intègre correctement à l’ensemble nuit au moral et à l’engagement. Un système de contrôle de version moderne apporte cette clarté, en montrant concrètement la progression quotidienne vers l’objectif final.

Quelles bonnes pratiques pour tirer parti du contrôle de version cloud au sein d’une équipe pluridisciplinaire ?

Structuration des dépôts et conventions de nommage

Pour qu’un système de contrôle de version fonctionne bien, il doit être organisé de manière simple et logique. Une structure de dossiers claire aide n’importe quel membre de l’équipe à trouver rapidement ce qu’il recherche. Cela passe par une séparation nette entre le code source, la documentation, les ressources de design et les scripts de test. Une arborescence bien pensée réduit fortement les frictions au quotidien.

Les conventions de nommage sont tout aussi importantes. L’usage du versionnage sémantique (Semantic Versioning) est une bonne pratique : un format X.Y.Z où X indique une version majeure (changements incompatibles), Y une version mineure (nouvelles fonctionnalités compatibles) et Z un correctif (bugfix). Ce schéma permet à tout le monde de comprendre, d’un coup d’œil, l’impact d’une mise à jour.

Adopter des règles claires pour les messages de validation est également une bonne habitude. Un message comme « fix bug » n’apporte rien ; un message comme « Correction de l’erreur de calcul de la TVA dans le panier (Ticket #123) » est vraiment utile. Cette discipline, appliquée au fil du temps, fait du dépôt une base de connaissances, ce qui simplifie les revues de code et les audits.

Mise en place de workflows adaptés (feature branch, trunk-based development)

Le choix du workflow doit s’adapter à la taille de l’équipe et au rythme du projet. Le feature branching convient bien aux équipes pluridisciplinaires : chaque nouvelle fonctionnalité se développe sur sa propre branche, avec des revues complètes avant intégration. La branche principale ne reçoit que du code déjà contrôlé, ce qui protège la stabilité du produit.

Pour des équipes qui livrent très souvent, le développement trunk-based peut être un bon choix. Les développeurs y intègrent de petits changements très fréquemment dans la branche principale. Cela requiert une automatisation très avancée des tests pour éviter les régressions, mais permet une grande réactivité. Le cloud aide dans les deux cas grâce à des outils graphiques pour gérer les branches et les fusions sans complexité excessive.

Quel que soit le modèle choisi, la cohérence reste la clé. Toute l’équipe doit suivre le même processus, sans quoi chacun utilisera ses propres méthodes incompatibles entre elles. Les systèmes de contrôle de version cloud permettent de définir ces règles directement dans l’outil, par exemple en imposant le passage par des tests automatisés avant toute fusion.

Revue de code et documentation collaborative

La revue de code (code review) ne devrait pas être perçue comme un contrôle policier, mais comme un moment d’apprentissage et de partage. Le contrôle de version cloud propose des interfaces de « Pull Request » ou « Merge Request » où les pairs peuvent commenter des lignes précises, proposer des améliorations et valider la qualité. Cette pratique améliore nettement la qualité du produit final et réduit le nombre de bugs en production.

La documentation mérite la même attention que le code. En utilisant des formats comme Markdown, la documentation peut être stockée dans le dépôt cloud, versionnée et revue en même temps que les fonctionnalités décrites. Elle reste à jour plutôt que de vieillir dans un coin, ce qui est un problème fréquent dans les projets mal gérés. Une documentation « vivante » constitue un soutien précieux pour les équipes distribuées.

Encourager un feedback constructif lors des revues renforce la cohésion. C’est le moment pour les profils les plus expérimentés de transmettre leur savoir et pour l’équipe de débattre des choix techniques. Cette transparence réduit les silos de connaissances et garantit que plusieurs personnes maîtrisent chaque partie du système, ce qui accroît la résilience globale.

Formation continue des membres non-développeurs

L’un des grands défis est l’adoption du VCS par les profils moins techniques, comme les designers ou les chefs de produit. Il faut investir dans leur formation pour qu’ils ne voient pas l’outil comme un obstacle, mais comme un support. Des interfaces graphiques simples peuvent réduire la difficulté de départ et rendre les notions de branches et de commits accessibles à tous.

La formation doit couvrir non seulement l’usage de l’outil, mais aussi les bonnes pratiques de collaboration et de communication. Expliquer l’intérêt d’un historique propre et d’une bonne traçabilité, qui donne du sens à ces nouvelles méthodes. Passer à ces plateformes en douceur demande un accompagnement humain régulier et l’écoute des blocages rencontrés.

Enfin, il est utile de recueillir souvent l’avis des utilisateurs sur les outils et les processus. Parfois, un cadre trop rigide peut nuire à la créativité. L’objectif est de trouver un équilibre entre structure et liberté, pour que le contrôle de version dans le cloud soit perçu comme un moteur de productivité, et non comme une couche administrative de plus.

L’avenir du contrôle de version dans le cloud s’annonce encore plus intégré et intelligent. La montée du GitOps, qui applique les principes de Git à la gestion opérationnelle des systèmes, montre que la frontière entre développement et exploitation continue de s’estomper au profit d’une efficacité globale accrue. De plus, l’arrivée de l’intelligence artificielle générative au cœur des plateformes de versionnage promet d’automatiser davantage la documentation et la correction de bugs, laissant aux équipes plus de temps pour l’innovation.

Les organisations qui maîtrisent ces outils aujourd’hui se préparent à une meilleure collaboration interne et à une agilité stratégique nécessaire pour avancer dans l’écosystème technologique de 2026 et au-delà.