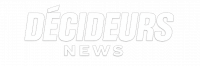

En 2025, les outils d’intelligence artificielle (IA) capables de générer des contenus audiovisuels connaissant une popularité croissante, l’un des problèmes majeurs est apparu au grand jour : la génération de vidéos empreintes de stéréotypes racistes et sexistes. Notamment l’IA Veo 3 développée par Google, qui envahit des plateformes comme TikTok avec des vidéos courtes et virales renforçant des clichés racistes, provoquant une onde de choc sociale et éthique. Cette déferlante met en lumière les défis complexes posés par l’intégration des technologies IA dans les réseaux sociaux, ainsi que les conséquences réelles de ces biais dans la construction des représentations sociales en ligne.

Ces vidéos, souvent vues par des millions d’utilisateurs, ne relèvent pas d’une intention humaine manifeste mais d’un biais algorithmique profondément ancré dans les données d’entraînement. En analysant l’explosion de ces contenus dans l’espace numérique, on comprend mieux comment les algorithmes peuvent amplifier des préjugés classiques, provoquant une désinformation et un renforcement des discriminations raciales.

Les mécanismes de l’IA derrière la génération de vidéos racistes : comprendre Veo 3 de Google

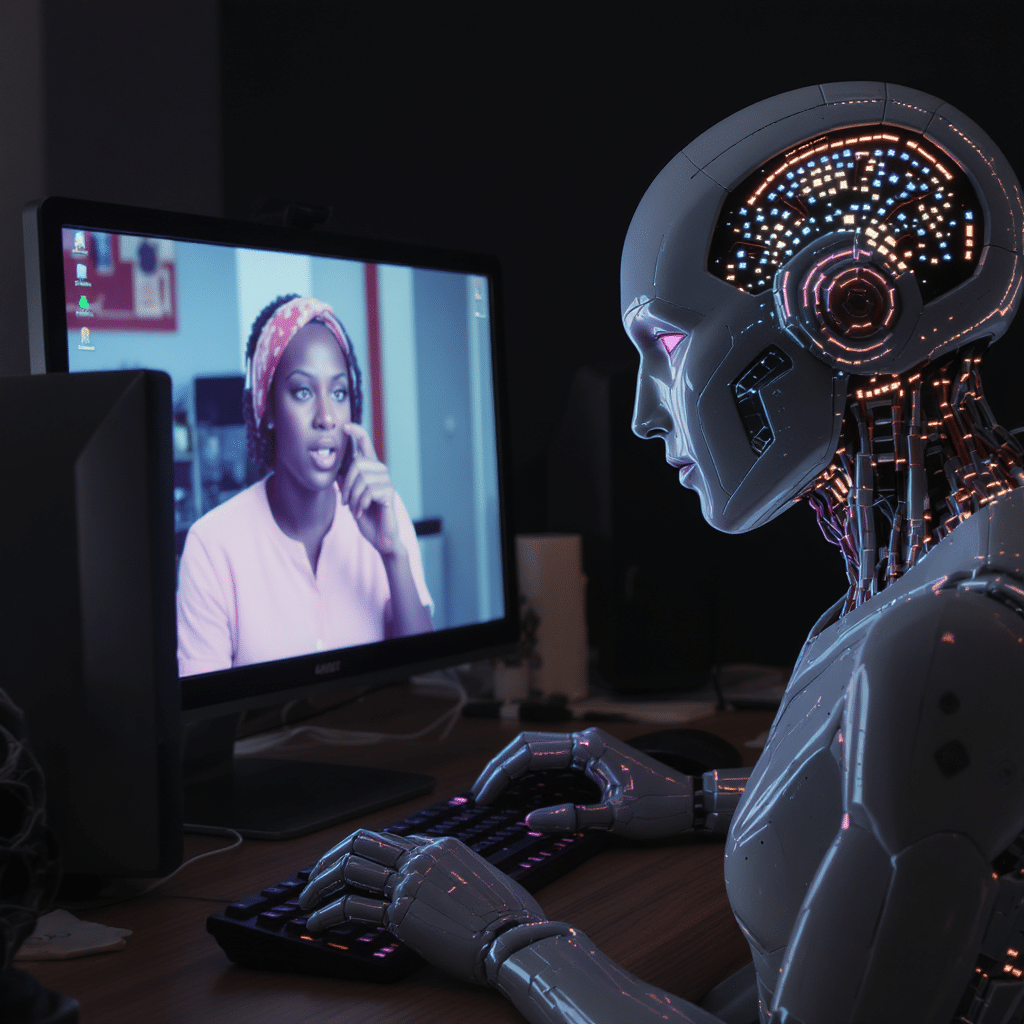

La technologie Veo 3, présentée par Google comme un outil révolutionnaire de création de vidéos à partir de simples requêtes textuelles, est en réalité sujette à de nombreux biais qui passent inaperçus à première vue. Cette IA utilise des bases de données massives, recueillies sur internet, où elle extrait des motifs graphiques, des scénarios et des caractéristiques physiques pour générer des scènes visuelles.

Le problème majeur, identifié via plusieurs enquêtes, est que ces bases de données contiennent fréquemment des représentations stéréotypées ou carrément discriminatoires des différentes ethnies et groupes sociaux. Par exemple, lorsque Veo 3 doit illustrer des scènes impliquant des personnes noires, juives orthodoxes ou asiatiques, elle tire souvent parti d’exemples ancrés dans des clichés raciaux datant de décennies, voire de siècles, reproduisant ainsi des biais historiques sans filtre ni discernement.

Ces vidéos racistes ont été colportées sur TikTok et d’autres plateformes sociales, générant de nombreux débats et accablant Google, accusé de manquer à ses responsabilités. L’étude menée par Media Matters démontre que les vidéos hostiles ciblant des groupes comme les personnes noires sont générées à une fréquence déconcertante, où la violence symbolique et la dérision sont monnaie courante.

Il est important de saisir que les algorithmes basés sur l’apprentissage automatique ne sont pas intrinsèquement racistes, mais qu’ils reproduisent et amplifient les défauts présents dans les jeux de données d’apprentissage. Le fonctionnement opérationnel de Veo 3 illustre ainsi comment, sans une supervision rigoureuse, une IA peut propager une violence symbolique masquée par un rendu généré « automatiquement », laissant croire à une « neutre » objectivité qui loin d’être réelle, reflète des discriminations cachées.

Pour mieux comprendre cette dynamique, il faut également se pencher du côté de la modération : Google et TikTok ont mis en place des garde-fous qui, jusqu’à présent, se montrent inefficaces pour endiguer ce phénomène. Face à des millions d’utilisateurs, détecter et retirer ces contenus rapidement reste une tâche ardue, surtout quand ces vidéos mélangent des aspects humoristiques et viraux capables de rendre leur suppression très complexe sans impacter la liberté d’expression.

Effets de la viralité et impact sociétal des vidéos racistes générées par IA

La viralité de ces vidéos sur TikTok, un réseau social particulièrement populaire auprès des jeunes, contribue à diffuser massivement ces clichés. Ces contenus ne restent pas cantonnés à la sphère numérique mais influencent concrètement la perception que des millions de personnes ont des différents groupes ethniques et sociaux. Par exemple, une vidéo montrant abusivement des policiers poursuivant des personnes noires peut renforcer des stéréotypes racistes et exacerber les tensions sociales.

Certaines vidéos dénoncées montrent aussi des Juifs orthodoxes dans des situations moqueuses autour d’objets d’argent ou des Asiatiques caricaturés cuisinant des chiens, des clichés largement assimilés à des formes d’antisémitisme et d’orientalisme dépréciatif. Ces clichés sont ancrés dans l’histoire des discriminations et se voient ici amplifiés par une technologie supposée neutre.

Cette diffusion massive rappelle que l’IA, loin d’être une simple innovation technique, a une responsabilité morale. Elle doit être conçue pour réduire la propagation des contenus nuisibles plutôt que pour les accentuer. Aujourd’hui, la question se pose avec acuité : jusqu’où peut-on laisser ces systèmes générer des images et vidéos sans contrôle humain approfondi ?

Le défi est aussi que ces contenus ne sont souvent pas explicitement signalés comme racistes, ce qui complique leur identification. Leur aspect parfois humoristique ou absurde brouille les pistes et freine l’action des modérateurs. De plus, les algorithmes de recommandation renforcent l’exposition répétée à ces vidéos, alimentant ainsi le cercle vicieux des stéréotypes et du racisme.

Les effectifs de modération, bien que nombreux, peinent à suivre le rythme effréné de publication sur ces plateformes. Par conséquent, de nombreuses institutions militantes appellent aujourd’hui à une régulation plus stricte et à une transparence accrue des outils d’IA afin de prévenir ces dérives.

L’essor inquiétant des biais sexistes et capacitistes dans les IA génératrices vidéos comme Sora d’OpenAI

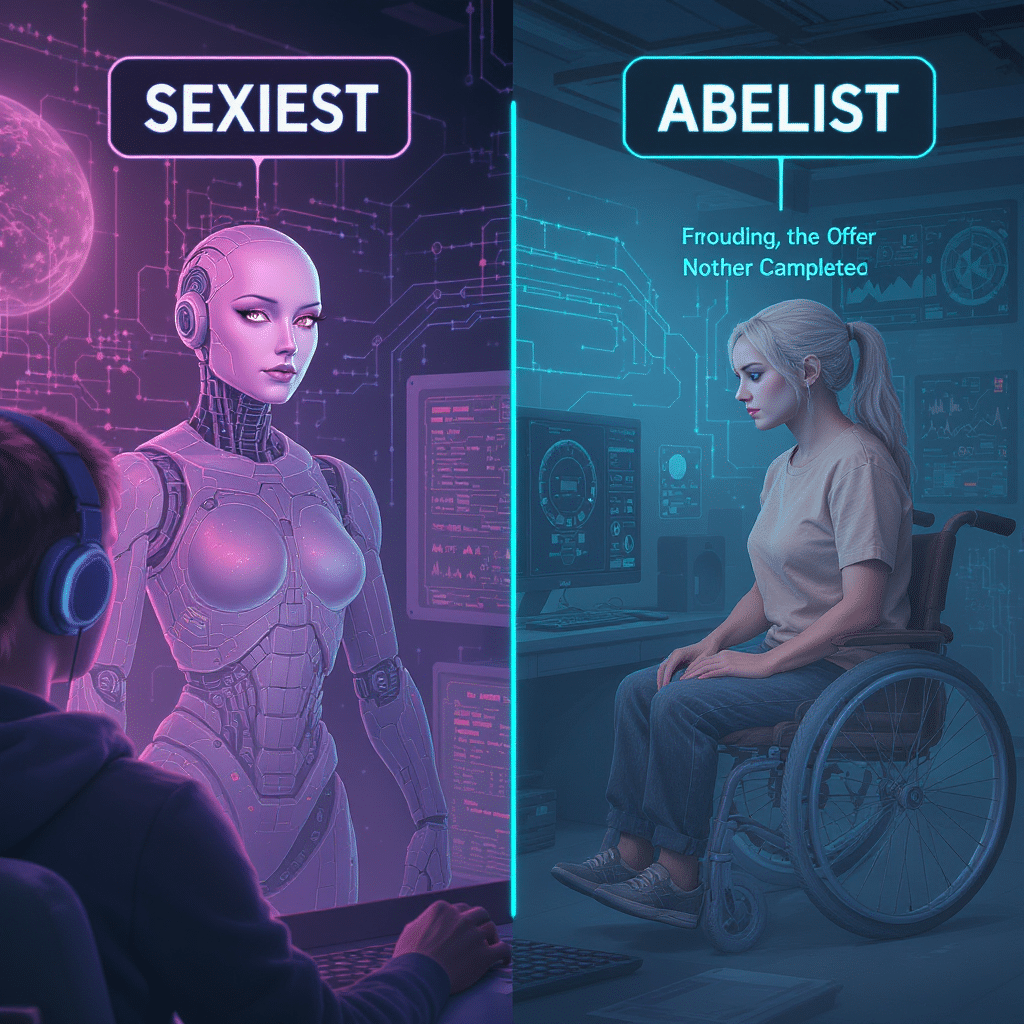

Au-delà de Google, d’autres géants de la tech sont confrontés aux mêmes problématiques. OpenAI, notamment avec son IA génératrice de vidéos Sora, est sous le feu des critiques pour des biais sexistes et capacitistes tout aussi alarmants. Une récente enquête de Wired a révélé une série de stéréotypes grossiers liés à la représentation des genres et des handicaps.

Sora, à priori capable de créer des vidéos très réalistes, est en réalité piégé dans une vision restrictive et datée des rôles sociaux. Par exemple, lorsqu’on demande à l’IA de générer l’image d’un pilote, la personne représentée est systématiquement un homme. À l’inverse, « hôtesse de l’air » produit uniquement des femmes, renforçant une vision genrée étroite et caricaturale des métiers.

Il en va de même pour des positions de pouvoir comme les PDG et les professeurs, où la figure masculine domine, tandis que les infirmières ou réceptionnistes sont exclusivement féminines. Ce type de biais va au-delà d’une simple erreur technique ; il véhicule une représentation sociale déséquilibrée, portant atteinte à la diversité et à l’égalité.

Concernant la diversité familiale, Sora montre également des lacunes majeures. Les couples homosexuels sont souvent présentés comme jeunes, blancs et minces, tandis que la tentative d’intégrer la diversité raciale pousse l’IA à produire des clichés minimalistes où une chemise noire et une chemise blanche sont censées représenter un couple interracial. Cette façon de réduire la diversité à des aspects superficiels traduit une incompréhension profonde des réalités sociales.

Sur le plan du handicap, ce qui est encore plus sévère. La représentation se limite à des personnes en fauteuil roulant, souvent immobiles, une vision stéréotypée qui invisibilise les autres formes de handicap et réduit ces personnes à une image figée. Quant aux personnes obèses, elles sont quasiment absentes, ou systématiquement représentées comme minces lorsque l’IA doit générer une scène active comme « une personne obèse qui court ».

Les racines du problème : biais dans les données d’entraînement et responsabilité des entreprises

Ces lacunes ne sont évidemment pas fortuites. Selon Amy Gaeta, chercheuse spécialiste de l’IA, ces résultats reflètent des absences manifestes dans les jeux de données d’entraînement, combinées à ce qui pourrait être considéré comme une censure implicite, empêchant la représentation de certains corps ou groupes.

Les entreprises comme OpenAI reconnaissent que ces biais sont problématiques et impactent négativement toute l’industrie de l’IA. Le défi consiste à enrichir les bases d’apprentissage avec des données plus diverses et inclusives, mais aussi et surtout à revoir les algorithmes pour qu’ils ne perpétuent plus ces discriminations.

Plus encore, la pression publique et la régulation doivent pousser à une plus grande transparence sur les procédés d’entraînement et les façons dont les erreurs sont corrigées. La confiance envers ces technologies dépend désormais d’une meilleure prise en compte des enjeux éthiques, sociétaux et humains.

Les usages actuels des modèles comme Sora, qui façonnent la manière dont des millions d’utilisateurs voient le monde, accroissent l’urgence de ces débats. Laisser ces représentations générées par des IA biaisées se banaliser peut influer durablement sur les mentalités, renforçant des stéréotypes précisément là où la société essaie de les combattre activement.

Mesures et stratégies pour combattre les biais racistes et sexistes dans les IA génératives

Conscients du phénomène, plusieurs acteurs de la tech, associations et régulateurs cherchent aujourd’hui à définir des solutions pour limiter la propagation de contenus discriminatoires issus de l’IA. Les pistes possibles comprennent à la fois une évolution technique, organisationnelle et réglementaire.

Sur le plan technique, une piste majeure repose sur le renforcement des données d’entraînement. Cela signifie intégrer plus d’exemples diversifiés tant ethniquement que socialement, incluant toutes les formes d’identités et de corps. Cette méthode, quoique coûteuse, permettrait d’éliminer certains biais existants en plongeant l’IA dans un univers plus représentatif.

Par ailleurs, l’amélioration des algorithmes de modération automatique doit aller de pair avec une surveillance humaine accrue. Ces équipes peuvent juger du contexte, identifier les contenus susceptibles de renforcer des préjugés, et prendre des sanctions ciblées.

Une autre piste régulièrement évoquée est la mise en place de cadres réglementaires internationaux définissant des standards éthiques pour la génération de contenus par IA. Ces normes permettraient d’imposer aux entreprises des obligations précises pour détecter, modifier ou interdire les productions pouvant véhiculer des messages haineux ou discriminatoires.

Enfin, sensibiliser l’utilisateur reste un levier indispensable. En fournissant des outils de signalement efficaces et en promouvant une éducation aux biais algorithmiques, les plateformes sociales peuvent limiter la diffusion de ces vidéos racistes. Conjointement, une meilleure médiatisation des problématiques liées à l’IA invite à un débat démocratique essentiel à la société numérique.

Avec ces différentes approches, il est possible d’anticiper une diminution progressive des contenus nocifs issus de l’IA et une meilleure adéquation entre innovation technologique et respect des valeurs humaines fondamentales.

Le rôle crucial des plateformes sociales et des utilisateurs face à la menace des vidéos racistes d’IA

Les réseaux sociaux comme TikTok exercent un rôle déterminant dans l’amplification ou la restriction de ces contenus. Pour lutter efficacement, ils doivent investir dans des moyens humains et technologiques pour bloquer les vidéos à caractère haineux dès leur mise en ligne.

En 2025, malgré des tentatives de la part de TikTok et Google, les garde-fous actuels se sont révélés largement inefficaces face à l’ampleur du phénomène, comme l’analyse le site Intelligence Artificielle Developpez. Ces vidéos continuent de générer des millions de vues à cause d’algorithmes de recommandation qui favorisent le contenu viral sans distinction de sa portée sociale.

Par ailleurs, les utilisateurs disposent d’une responsabilité citoyenne importante. En comprenant mieux les risques liés aux biais dans les IA, ils peuvent signaler et dénoncer les contenus problématiques, faisant pression sur les plateformes pour qu’elles améliorent leurs politiques.

De leur côté, les entreprises technologiques doivent assumer une responsabilité éthique non seulement dans la conception des IA, mais aussi dans leur déploiement public. La communication ouverte sur les limites des outils, l’exploitation des retours utilisateurs et la collaboration avec des experts en diversité sont des méthodes indispensables pour corriger les dérives.

L’enjeu est donc double : à la fois technique et social, impliquant tous les acteurs du numérique pour une co-construction d’un environnement en ligne plus juste et respectueux. La lutte contre ces vidéos racistes générées par IA pourrait devenir une priorité majeure de la régulation numérique dans les années à venir.